OpenAI、谷歌、腾讯、蚂蚁等联合编制大模型安全国际标准正式发布

4月16日,世界数字技术院(WDTA)发布了《生成式人工智能应用安全测试标准》和《大语言模型安全测试方法》两项国际标准。这也是国际组织首次就大模型安全领域发布国际标准,代表全球人工智能安全评估和测试进入新的基准。

据了解,这两项国际标准是由OpenAI、蚂蚁集团、科大讯飞、谷歌、微软、英伟达、百度、腾讯等数十家单位的多名专家学者共同编制而成。

与会的WDTA人工智能安全可信负责任工作组组长黄连金表示,随着人工智能系统,特别是大语言模型继续成为社会各方面不可或缺的一部分,以一个全面的标准来解决它们的安全挑战变得至关重要。

此次发布的标准汇集了全球AI安全领域的专家智慧,填补了大语言模型和生成式AI应用方面安全测试领域的空白,为业界提供了统一的测试框架和明确的测试方法,有助于提高AI系统安全性,促进AI技术负责任发展,增强公众信任。

其中,《生成式人工智能应用安全测试标准》由WDTA作为牵头单位。该标准为测试和验证生成式AI应用的安全性提供了一个框架,特别是那些使用大语言模型(LLM)构建的应用程序。

它定义了人工智能应用程序架构每一层的测试和验证范围,包括基础模型选择、嵌入和矢量数据库、RAG或检索增强生成、AI应用运行时安全等等,确保AI应用各个方面都经过严格的安全性和合规性评估,保障其在整个生命周期内免受威胁和漏洞侵害。

《大语言模型安全测试方法》由蚂蚁集团作为牵头单位。该标准则为大模型本身的安全性评估提供了一套全面、严谨且实操性强的结构性方案。

它提出了大语言模型的安全风险分类、攻击的分类分级方法以及测试方法,并率先给出了四种不同攻击强度的攻击手法分类标准,提供了严格的评估指标和测试程序等,可解决大语言模型固有的复杂性,全面测试其抵御敌对攻击的能力,使开发人员和组织能够识别和缓解潜在漏洞,并最终提高使用大语言模型构建的人工智能系统的安全性和可靠性。

据了解,世界数字技术院(WDTA)是在日内瓦注册的国际非政府组织,遵从联合国指导框架,致力于在全球范围内推进数字技术,促进国际合作。AI STR(安全、可信、负责任)计划是WDTA的核心倡议,旨在确保人工智能系统的安全性、可信性和责任性。蚂蚁集团、华为、科大讯飞、国际数据空间协会(IDSA)、弗劳恩霍夫研究所、中国电子等均为其成员单位。

近年来,世界各国都在加强对于大模型安全的研究和管控。我国先后发布了《全球人工智能治理倡议》《生成式人工智能服务管理暂行办法》《生成式人工智能服务安全基本要求》等,旨在促进生成式人工智能安全可信发展,推进全球人工智能治理领域合作共识。

作为标准参与单位代表,蚂蚁集团机器智能部总经理、蚂蚁安全实验室首席科学家王维强受邀参会并进行了发言。他表示,生成式AI将释放巨大的生产力,但也要对它带来的新风险高度警惕。

大型科技公司应在促进生成式AI安全和负责任的发展中发挥关键作用,利用其资源、专业知识和影响力推动最佳实践,构建一个优先考虑安全、隐私和道德考量的生态系统。例如,通过制定行业标准与指南,为开发和部署生成式AI系统的开发者和机构提供清晰指导;投入研发并开放保障生成式AI安全的工具,形成产业共治。

(本文来源新闻晨报,如有侵权请联系删除)

查看未读消息

查看未读消息 查看最新消息

查看最新消息

分享

分享

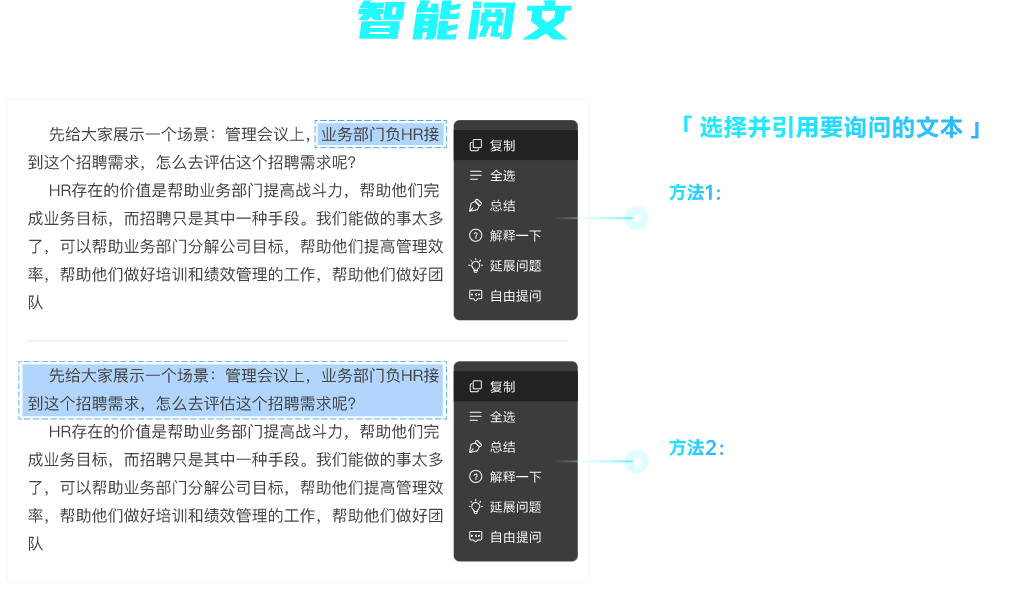

复制

复制 全选

全选 总结

总结 解释一下

解释一下 延展问题

延展问题 自由提问

自由提问

复制

复制 分享

分享